Ethische Scheindebatten, bei denen nur die Reichen mitreden?

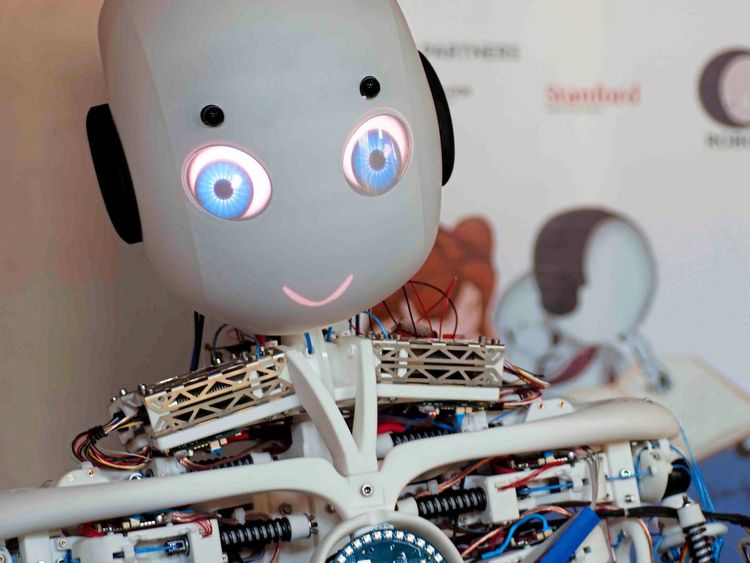

Noch scheint sie in Österreichs Firmen eine große Unbekannte zu sein: künstliche Intelligenz. Lediglich 13 Prozent der Unternehmen wenden sie an, 42 Prozent befassen sich aktiv damit, zeigt eine BGC-Umfrage. Und laut einer neuen Deloitte-Befragung hat sich erst die Hälfte der befragten 500 Führungskräfte, darunter auch österreichische, mit dem Thema beschäftigt, ein Drittel berücksichtigt KI in der Firmenstrategie.

Auch die arbeitende Bevölkerung ist kritisch. Vier von zehn Befragten sorgen sich besonders wegen des Einsatzes von künstlicher Intelligenz, fast jeder Zweite meint, dass Firmen KI stärker regulieren sollten. Das ergab eine weltweite Befragung im Auftrag der Stiftung Weltwirtschaftsforum.

Als Reaktion auf solche Ängste haben Staaten, Organisationen und Firmen ethische Leitlinien entwickelt. In Österreich gibt es dafür etwa seit 2017 den Rat für Robotik und Künstliche Intelligenz, die EU-Kommission setzt auf eine Expertengruppe, die im April ethische Leitlinien präsentiert hat. Doch die Vorstellungen von einem ethisch verantwortlichen Umgang mit KI gehen weit auseinander, fanden Forscher der ETH Zürich heraus, die 84 solcher Dokumente analysierten. Darin fand sich kein ethisches Grundprinzip, schreiben sie im Fachblatt Nature Machine Intelligence. Insgesamt konnten sie elf Prinzipien identifizieren, fünf davon in mehr als der Hälfte der Leitlinien: Transparenz, Gerechtigkeit, das Verhindern von Schaden, Verantwortung und Datenschutz.

Hauptanliegen: Transparenz

Transparenz ist das häufigste Anliegen und meint etwa, dass die Technologie und deren Einsatz besser erklärt werden sollten, insbesondere, wie die Daten genutzt werden oder wer bei Fehlern haftet. Das Hauptziel der Transparenz sei, Missbrauch oder unerwünschten Nebenwirkungen vorzubeugen. "Erstaunlich ist, wie widersprüchlich die Dokumente in sich selbst teilweise sind", sagt Studienautorin Anna Jobin. Etwa sei ein oft genanntes Ziel, Diskriminierung zu verhindern, indem viele ausgewogene Datensätze verwendet werden. "Im gleichen Dokument findet man, dass Nutzer die Kontrolle über ihre Daten haben sollten. Das ist aber schwer mit dem Sammeln größerer Datenmengen zu vereinbaren."

Während die Transparenz im Vordergrund steht, werden Prinzipien wie Vertrauen, Solidarität oder Nachhaltigkeit selten erwähnt, zeigt die ETH-Studie. Überhaupt werde hier häufig "ethics washing" betrieben, schrieb Thomas Metzinger, Professor für theoretische Philosophie an der Uni Mainz, im April im Tagesspiegel.Das bedeute laut Metzinger, dass die Industrie ethische Debatten organisiere, um sich Zeit zu kaufen und die Öffentlichkeit abzulenken. "Wirksame Regulation und echte Politikgestaltung" würden so verschleppt.

Auch ETH-Studienautorin Jobin plädiert, sich einig zu werden, wie ethische Prinzipien entwickelt und umgesetzt werden können, anstatt immer neue Richtlinien zu erstellen. "Dank dieses Überblicks wissen wir nun, wo wir künftig einen noch größeren Fokus setzen müssen", sagt sie. Auch bei den Ländern zeigt die Analyse ja ein globales Ungleichgewicht. Industriell weiterentwickelte Länder prägen die Diskussion, Afrika, Süd- und Mittelamerika und Zentralasien sind unterrepräsentiert. "Wenn wir den Anspruch haben, dass KI weltumgreifend wirken soll, sollte auch die ganze Welt mitreden", sagt Jobin. (4.10.2019, set)