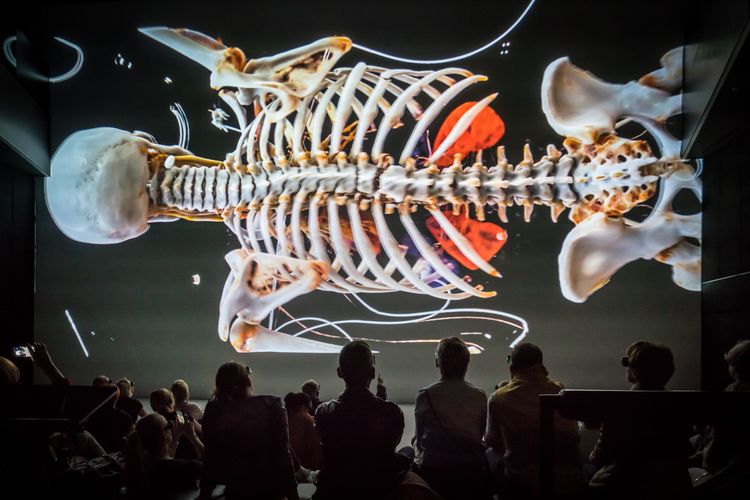

Der Anblick ist überwältigend. Dort, wo gerade noch Dunkelheit den Raum erfüllte, rotiert nun ein mehrere Meter großes Skelett vor den Augen. Dank der 3D-Brille auf meiner Nase und der dreidimensionalen Darstellung kann ich jeden Knochen und jede Struktur bis ins kleinste Detail erkennen.

"Das ist eine Kanadierin, die einen Reitunfall hatte", sagt Primar Franz Fellner, Vorstand des Radiologieinstituts des Kepler-Universitätsklinikums in Linz. Mit dem Controller einer Spielkonsole dreht Fellner den Körper, zoomt hinein und lenkt den Blick auf die Verletzungen. Erst jetzt fallen die gebrochenen Rippen und der bedrohlich große Spalt in der Wirbelsäule auf.

Gibt Fellner neugierigen Journalisten nicht gerade Privatvorführungen, vermittelt er im Ars Electronica Center angehenden Ärztinnen und Ärzten mithilfe von virtueller Realität die Anatomie des menschlichen Körpers. Und zwar auf eine Weise, wie es Bücher und Videos, aber auch das Studium von Leichen nicht können.

"Entscheidend ist hier: Diese Menschen sind lebendig", betont der Radiologe und schaltet in Echtzeit zwischen hunderten Schichten des Körpers hin und her. Das durchblutete Herz, die mit Luft gefüllte Lunge, die Leber, die Niere, alle Organe und die feinsten Verästelungen der Gefäße bis hin zu den Muskelfasern, Sehnen und das in Liquor gebettete Gehirn können durchflogen und von allen Seiten inspiziert werden. Ohne ein Skalpell anlegen zu müssen, wird der Körper von Kopf bis Fuß seziert.

Inspiration Gollum

Möglich macht dies eine digitale, dreidimensionale Darstellung des Körpers namens "Cinematic Rendering" in einer Qualität, die man sonst nur aus Animationsfilmen kennt. Dazu herangezogen werden Computertomografien (CT) und Magnetresonanztomographien (MRT) von realen Patienten. Das Ziel: Mit einer realistischen Darstellung soll die Kommunikation zwischen Arzt und Patient verbessert, Wissen im Studium anschaulicher vermittelt und Chirurgen sollen bei der Vorbereitung eines Eingriffs unterstützt werden. Die präzise räumliche Darstellung hilft dabei, die exakte Lage von Tumoren und Blutgefäßen oder angeborene Anomalien zu erkennen.

Ende Mai wird eine zwei Jahre laufende klinischen Studie der Universitätsklinik Erlangen dazu veröffentlicht. Sie wird zeigen, dass der Ansatz aufgeht. Cinematic Rendering könne Eingriffe effizienter machen und das anatomische Verständnis verbessern, hieß es dazu in einer Aussendung zum diesjährigen europäischen Radiologenkongresses ECR in Wien. Die Fehlerrate bei Fachchirurgen sei im Testlauf von 11,1 auf 0,8 Prozent gefallen. Seit gut einem Jahr bietet Hersteller Siemens nun bei all seinen Bildgebungssystemen eine Ansicht im Renderingverfahren an.

Laut Primar Fellner, der führend beim Lehreinsatz der Technologie ist, könne man dadurch die Zeit reduzieren, die Patienten in Narkose verbringen, und so das Risiko damit einhergehender Komplikationen senken. Überdies würde es sich wirtschaftlich rechnen, wenn OPs durch eine klarere Ausgangslage kürzer sind. Gleiches gelte für die Ausbildung von Studierenden: Zwar könne selbst die realistischste 3D-Aufbereitung nicht die Arbeit an Leichen ersetzen. Doch um vielen Menschen gleichzeitig die Funktionsweise des Körpers zu zeigen, seien derartige Methoden ein großer Fortschritt.

Anatomie im Deep Space

Fellner weist auch auf ein echtes Unikum der Linzer Universitätsklinik hin: Man will ein 3D-gestütztes Anatomiestudium auf Basis virtueller Realität ermöglichen. Im Vorführungsraum des Ars Electronica Center können dank eines Projektionssystems namens Deep Space 8K eine große Gruppe von Studierenden sowie interessierte Museumsbesucher auf eine Reise durch Fleisch und Knochen geschickt werden. Dabei kommt ein stereoskopisches Projektionsverfahren zum Einsatz, das vom Team des Ars Electronica Futurelabs rund um Horst Hörtner, Christopher Lindinger und Roland Haring entwickelt wurde.

Ursprünglich für Kunstinstallationen entworfen, wurde das System 2015 runderneuert und mit acht 4K-Projektoren ausgestattet, die ein Bild mit 32 Millionen Pixeln gleichzeitig auf eine 16 mal neun Meter große Wand und auf den Boden projizieren. Dank der großen Fläche und mittels Shutter-Brillen, wie man sie von 3D-Fernsehern kennt, nehmen Besucher die Inhalte so wahr, als würden sie sich tatsächlich im Raum bewegen.

KI fürs Polytrauma?

"Und wie geht es der verunfallten Kanadierin heute?", so die Frage Primar Fellner, nachdem er anhand der digitalen Nachbildung der Verunglückten über den Aufbau des Rückenmarks aufgeklärt hat. "Die hat ihren Unfall gut überstanden", beruhigt er. Vor dem Hintergrund einer thailändischen Beingefäßanomalie liegt nun der Blick in die Zukunft nahe. Wird es bald möglich sein, nicht nur 3D-Modelle eines Körpers zu erstellen, sondern diese gleich per Computer analysieren lassen zu können?

Der Radiologe ist optimistisch, aber er ist auch Realist. Die Verknüpfung von Bildgebung und Bilderkennung in Echtzeit werde noch ein paar Jahre brauchen: "Es kann gut sein, dass man etwa bei einem Polytrauma dann von einem Algorithmus angezeigt bekommt, wo sich die Verletzungen befinden. Aber das dauert noch."

Die Fortschritte im Bereich des Maschinenlernens könnten hier wegweisend sein. An selbstlernenden Computersystemen zur Klassifizierung von Tumoren etwa wird schon seit einigen Jahren erfolgreich geforscht.

Erweiterte Realität

Einen neuen Ansatz zur Verschmelzung realer und digitaler Inhalte in der Medizin, die auf der gleichen Rendering-Technologie basiert, stellte Microsoft beim letzten Radiologenkongress in Wien vor: Mithilfe der Datenbrille Hololens 2 könnten sich Chirurgen bei der OP-Vorbereitung einen realitätsnahen dreidimensionalen Überblick direkt an der betroffenen Körperregion verschaffen.

Viel von der Verschmelzung von Realität und Virtualität versprechen sich auch Chirurgen, die im mikroskopischen Bereich agieren – also beispielsweise Eingriffe am Auge, im Ohr, im Gehirn oder an der Wirbelsäule durchführen.

Robotermikroskop und Miniknochen

Ende 2019, Anfang 2020 will das Tiroler Unternehmen BHS Technologies das erste sogenannte Roboticscope auf den Markt bringen. Das System, das Ärzten mittels Virtual-Reality-Brille die Steuerung eines Mikroskops ermöglicht, das von einem Roboterarm bewegt wird, soll die aufwendigen und oft stundenlangen Operationen an den sensibelsten Stellen des Körpers vereinfachen und beschleunigen. Nach zweieinhalb Jahren Entwicklungsarbeit und zwei Millionen Euro an Förderungen und Investitionen startet man im Juni mit klinischen Studien, wie Miterfinder und BHS-Geschäftsführer Markus Hütter erklärt. Eine Innovation, die bereits in der Prototypphase auf großes Interesse bei Ärzten stieß.

"Sie müssen sich vorstellen, wir operieren hier an Strukturen, die nicht größer sind als ein mal drei Millimeter", sagt Professor Gunesh Rajan im Gespräch mit dem STANDARD und verweist dabei auf den Steigbügel im Gehör, den kleinsten Knochen im menschlichen Körper. Der Chefarzt am Luzerner Kantonsspital ist spezialisiert auf Hals- und Gesichtschirurgie. Um in so winzigen Arealen arbeiten zu können, greifen Mikrochirurgen auf binokulare Mikroskope zurück, um überhaupt sehen zu können, was sie vor sich haben. Eine mitunter mühselige Prozedur, denn bei jeder Änderung des Blickwinkels müssen die Ärzte das Operationsbesteck weglegen und das Mikroskop neu ausrichten.

Hände frei für den Patienten

"Nach fast 70 Jahren ist das endlich etwas Neues", zeigt sich auch Alexander Huber begeistert. Er ist Leiter der Klinik für Ohren-, Nasen-, Hals- und Gesichtschirurgie des Universitätsspitals Zürich. Der große Vorteil des Robotermikroskops sei, dass sich dieses synchron zum Kopf des Arztes bewegt, der das VR-Headset trägt. Mittels der beiden runden 4K-Displays vor den Augen sieht man ein dreidimensionales Bild von allem, worauf die Linsen gerichtet sind. So könne man sich ein Rundumbild verschaffen, ohne den Blick von der Operationsstelle abwenden zu müssen.

Laut Hütter sei dieser Fortschritt erst durch die rasanten Entwicklungen in der Displayherstellung und in der Robotik möglich geworden. So kleine hochauflösende und verzögerungsfreie Bildschirme, die kleinste Strukturen scharf darstellen, wären vor der Erfindung der Smartphones und der jüngsten VR-Systeme nicht denkbar gewesen. Die zunehmende Automatisierung von Fabriken wiederum habe uns Roboterarme beschert, die selbst im Dauerbetrieb und über Jahre eine Präzision von 0,02 Millimeter halten können.

Kürzere, sicherere OPs

Wie gut das Robotermikroskop letztlich angenommen wird, bleibt abzuwarten. Die Kosten für das OP-Gerät aus Österreich würden die eines analogen Spezialmikroskops jedenfalls nicht übersteigen. Die vollständige Digitalisierung der Anzeige inklusive Liveaufnahmefunktion könnte sich im Hinblick auf moderne Darstellungsverfahren zudem bezahlt machen. Statt CTs oder Röntgenbilder auf einem separaten Bildschirm anzuzeigen, könnte man diese dem Arzt direkt in die Brille einspeisen. Eine Funktion, die dem Hersteller zufolge bereits für künftige Updates angedacht ist.

Bis es so weit ist, sollen präzisere und kürzere Operationen genügend Anreize für Spitäler, Patienten und letztlich Mikrochirurgen sein, deren Arbeitsbedingungen Rückenprobleme begünstigen, so Hütterer.

3D-gedrucktes Geschwür

Mit Blick auf den Mikrokosmos der Krankheiten und die kanadische Reiterin im Ars Electronica Center, deren Frakturen man gespenstisch nahe kommen kann, stimmen die aktuellen Entwicklungen zuversichtlich, dass die Bildgebungssysteme von morgen Operationen tatsächlich sicherer machen könnten. Mit der perfekten virtuellen Darstellung ist für Professor Huber aber noch lange nicht das Ende der Fahnenstange erreicht.

Er erzählt von einer aktuellen Studie des Universitätsspitals Zürich, in der basierend auf CTs, MRTs und weiteren Bilddaten 3D-Drucke erstellt werden, um sich damit nicht nur visuell, sondern auch haptisch auf Eingriffe vorbereiten zu können. Auch das mache möglich, Patienten besser aufzuklären und Operationen effizienter zu gestalten. Außerdem kann man damit in Zukunft sein hoffentlich erfolgreich entferntes Geschwür als Kunststoffandenken gleich mit nach Hause nehmen. (Zsolt Wilhelm, 25.5.2019)