Künstliche Intelligenz (KI) ist aus unseren Lebens- und Berufswelten nicht mehr wegzudenken. Damit verbindet sich viel Emotion – von der gehypten Lösung für "alle" Probleme über die differenzierte Betrachtung der Chancen und Risiken bis hin zu mal mehr, mal weniger seriösen Warnungen, die Mehrheit menschlicher Arbeitsplätze sei durch intelligente Maschinen gefährdet.

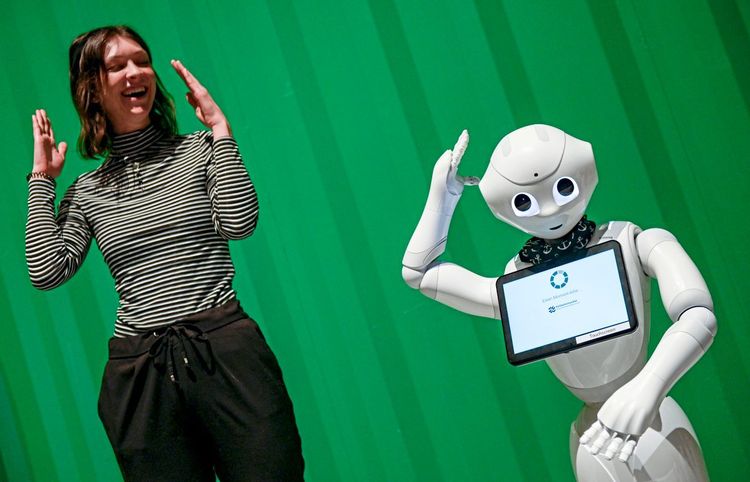

Hier beginnt oft schon das Missverständnis: Die KI gibt es nicht. Wer über KI spricht, muss präzisieren, wovon die Rede ist: von datengetriebenen Ansätzen wie Machine Learning? Oder von wenig datenabhängigen Verfahren, die aufgrund der Rückmeldungen ihrer Sensoren lernen? Von autonom navigierenden Fahrzeugen? Von Roboterarmen, die mittels Bilderkennung lernen, Objekte oder Menschen zu erkennen, und entsprechend eigenständig agieren, zum Beispiel als kollaborative Roboter? Von der Mustersuche in den Betriebsdaten einer Fabrik, die helfen soll, zu prognostizieren, ob eine Maschine demnächst ausfallen wird? Von der Dialogfähigkeit eines Pflege- oder Spielroboters, der Empathie emulieren kann? Die Liste der technischen Verfahren und ihrer Anwendungen ist lang, und manche sind bereits gängige Praxis. Andere liefern im Entwicklungsbetrieb gute Ergebnisse, sind aber erst eingeschränkt zertifiziert, da ihr Verhalten und ihre Sicherheit auf Wahrscheinlichkeiten beruhen. Hinzu kommen Probleme mit der Transparenz der Entscheidungsfindung: Sobald eine Maschine autonom handelt, muss zweifelsfrei nachvollziehbar sein, warum sie eine Handlung gesetzt oder nicht gesetzt hat (sogenannte "explainable" AI).

Gerade bei der Anwendung neuronaler Netze – eine der derzeit vielgenannten Technologien – hat sich gezeigt, dass maschinelles Lernen dieser Überprüfung unbedingt bedarf: Nur, weil eine KI Objekte oder Menschen mit attraktiver Trefferquote unterschiedlichen Kategorien zuordnet, heißt das nicht, dass dies auf den richtigen Kriterien beruht. Wenn zum Beispiel eine KI im Internet drei wesentliche Lebensformen auszumachen glaubt – Frauen, Männer und Katzen – muss das nicht bedeuten, dass dies dem realen Zustand entspricht. Noch weniger muss es den gewünschten Zustand repräsentieren, der vielleicht andere selten vertretene Lebensformen zu stärken sucht. Und wer weiß darüber hinaus, ob die besagte KI anhand tatsächlich weiblicher, männlicher oder katzentypischer Eigenschaften unterschieden hat, oder auf Basis anderer Merkmale, die ohne kausalen Zusammenhang so gut mit unserer Unterscheidung von Frauen, Männern und Katzen korreliert, dass wir geneigt sind, der KI zu vertrauen, sie habe "gelernt, wesentliche Lebensformen zu unterscheiden"?

Maximen für die Aus- und Weiterbildung zum Thema KI

Soweit ein (vereinfachter) Auszug der aktuellen Diskussion um KI-Systeme. Nicht nur für Gesellschaft, Politik und Wirtschaft stellt sich die Frage, wie der Umgang mit den neuen Systemen zu erlernen ist, sondern, spezieller noch für Schulen, Hochschulen öffentliche und gewerbliche Weiterbildungsanbieter oder Schulungsabteilungen im Unternehmen. Zunächst würde man dem Curriculum oder Weiterbildungsprogramm generelle Maximen für den Umgang mit KI zugrunde legen, wie sie zum Beispiel der österreichische Rat für Robotik in seinem White Paper umrissen hat. Dies betrifft ethische und gesellschaftliche Fragen, berührt aber auch handfeste technische Themen wie zum Beispiel Maschinen- und Datensicherheit. Ein weiteres Prinzip erschließt sich aus der Grundordnung der sozialen Marktwirtschaft: Im Bereich der Produktion von Gütern und Dienstleistungen gilt es, wettbewerbsfähig zu bleiben – zu Bedingungen für die arbeitenden Menschen, die unserem hohen Wertestandard entsprechen. Geht es im zweiten Schritt um die Verteilung des erwirtschafteten Wohlstands (Subventionen, Steuern), wird man stärkeres Gewicht auf soziale Kriterien legen.

Der gedankliche Sprung zur Frage dieses Beitrags, was Aus- und Weiterbildenden unterrichten sollen, scheint zunächst weit: Sollte nicht das Ingenieurwesen vordringlich über Mathematik, Statistik und Programmierkenntnisse sprechen? Über Sensoren und die intelligente Verarbeitung der Daten die sie liefern? Sollten nicht die Arbeitssoziologie vor allem über arbeitsorganisatorische Fragen diskutieren, und die Rechtswissenschaften Fragen wie die Zurechenbarkeit der Folgen des Handelns autonomer Roboter auf den Speisezettel der Lernenden setzen? Beides wird wichtig sein: Fokussiert ein Bildungsprogramm rein auf Lernziele des eigenen Faches, degradiert das die Absolventinnen und Absolventen zu blassen Fachidioten, die (hoffentlich) ihre (anderswo erworbene) Sensibilität für die oben angerissenen Fragen in die Anwendung dieses Wissens einbringen werden. Beschränkt man sich dagegen auf ethische Imperative und Willenserklärungen, ohne konkrete Techniken in angemessener Tiefe zu unterrichten, wird das Handeln der Absolventinnen und Absolventen kaum über Absichtserklärungen hinauskommen.

Herausforderungen für Bildungsprogramme

Für Aus- und Weiterbildende ergeben sich diverse Herausforderungen: Zunächst müssen Lernziele und -inhalte das jeweilige Fachwissen in angemessener Dosis mit dem Wissen darüber verbinden, was übergreifend im Umgang mit KI gewollt und nicht gewollt sein kann. Zum zweiten ist zu bedenken, dass angesichts der raschen technologischen Veränderung heutige Bildungsprogramme auf Basis heute verfügbarer Technologien Menschen unterrichten, die zukünftig Kompetenzen benötigen, die wir heute noch nicht kennen. Das erweitert den Aus- und Weiterbildungsbedarf um Themen im Zusammenhang mit Technologieentwicklung, -assimilation und -folgenabschätzung.

Wie in vielen anderen Bereichen der Digitalisierung, wird man sich iterativ nach vorne arbeiten müssen. Zum Beispiel betreibt die Fachhochschule Technikum Wien eine Digitalen Fabrik als Lernort für Engineeringstudiengänge und Unternehmen. Mit hochmodernem industriellen Equipment sind verschiedenste Konzepte der intelligenten Produktion realisiert. Gemäß dem Ansatz der flexiblen Fertigung erledigen mobile Roboter Transportaufgaben zur Herstellung individualisierter Produkte. KI unterstützt die Roboter bei der Navigation und Lokalisierung. Mobile Roboter agieren als Schwarm und besitzen Manipulatoren zur Interaktion mit den Bearbeitungsstationen. Darüber stehen den Lernenden zahlreiche Use Cases zur Verfügung, die zum Beispiel die Integration vielfältiger Sensoren und Aktuatoren oder die Möglichkeiten der Bildverarbeitung zur Realisierung automatisierter robotergestützter Applikationen mit nicht konstanten und dynamischen Eingangsgrößen praktisch demonstrieren.

Wenn hier von KI (präziser: Von maschinellem Lernen und statistischem Schlussfolgern) die Rede ist, betrifft das vor allem nicht klar definierbare Aufgaben, wie zum Beispiel das Greifen von Objekten in unbekannter Lage oder die Reaktion auf unerwartete Stöße. Klassische Methoden wie tiefe faltende neuronale Netze zur Objektdetektion beziehungsweise zur Lagebestimmung für Greifprozesse werden um moderne parameterfreie Methoden zur Navigation erweitert. Dabei erlernt der mobile Roboter basierend auf historischen Daten selbstständig die Fahrzeugdynamik, was sowohl in der Lokalisierung als auch in der Pfadplanung einsetzbar ist. Dank immenser Unterstützung der Industrie stehen reale industrielle Systeme zur Verfügung. Die technischen Curricula insbesondere der Studiengänge Mechatronik/Robotik, Maschinenbau, internationales Wirtschaftsingenieurwesen und Innovations- und Technologiemanagement können modernste Technologie unterrichten, die noch dazu durch die intensive Forschungstätigkeit der Fakultät am Puls der Zeit bleibt, zum Beispiel wenn es darum geht, erlernte Fahrzeugmodelle für die Navigation in Echtzeitanwendungen zugänglich zu machen.

Technologisch bleiben also kaum Wünsche offen. Die dritte Herausforderung für die Gestalter der Studiengänge, Laborpraktika und industriellen Lehrgänge liegt darin, die übergreifende und interdisziplinäre Klammer bewusst zu machen, die die Technologie betreffend die Auswirkungen ihrer Anwendung reflektiert, in der Fabrik zum Beispiel die Gestaltung von Produktionsarbeitsplätzen in der intelligenten Umgebung, von der eigeninitiativ autonome Signale an den Menschen ausgehen. In Fächern wie Innovations- und Technologiemanagement fällt das leicht: Die Lernenden sind mit dem Motiv angetreten, eben diese Fragen zu stellen. Disziplinbedingt liegen ihre Schwierigkeiten eher darin, die KI in ihrer technischen Komplexität zu erfassen. Genau umgekehrt erleben es rein technische Studiengänge wie zum Beispiel Mechatronik oder Maschinenbau: Das Motiv, diese Fächer zu studieren ist in der Regel die Faszination an der Technik; "philosophische Abschweifungen" werden oft als irrrelevante Pflichtübung abgetan. Bei gleichem Lernziel betreffend den förderlichen Umgang mit KI erfordert allein diese Unterschiedlichkeit der Lernenden andere didaktische Zugänge.

Ein vorläufiges Fazit – Aufruf zum interdisziplinären Diskurs

Diese hier exemplarisch für zwei Zielgruppen angestellte Überlegung lässt sich für andere Adressaten analog fortsetzen. Weitere Unterscheidungen kommen hinzu. Soll zum Beispiel jemand die Technologie "nur" verwenden können, oder ist es Ziel, selbst KI-Systeme entwickeln zu können? Wie erschließt man dem Informatiker die physikalische Komplexität mechanischer Systeme, und umgekehrt dem Maschinenbauer die Risiken einer schlecht reflektierten Algorithmenanwendung? Hier wird der interdisziplinäre Diskurs zur Schlüsselqualifikation. Den Bildungsgestaltern gehen die Fragen nicht aus. Uns bleibt, eine letzte Frage zu stellen: Wer sind sie, die Gestalter dieser Lernprogramme und Curricula? Kann man bei technisch hochspezialisierten Aus- und Weiterbildnern voraussetzen, dass das Bewusstsein betreffend nicht-technologische Fragen schon hinreichend weit entwickelt ist? Woher bekommen umgekehrt die nicht-technischen AusbildnerInnen die technische Überblicksperspektive in der für ihre Zwecke angemessen, und sachlich korrekt reduzierten Komplexität? Anders gesagt: Who is teaching the teachers? An diesem wichtigen Multiplikatorpunkt bleibt viel zu tun, und auch dazu ist der interdisziplinäre Dialog unverzichtbar! (Corinna Engelhardt-Nowitzki, 17.1.2020)