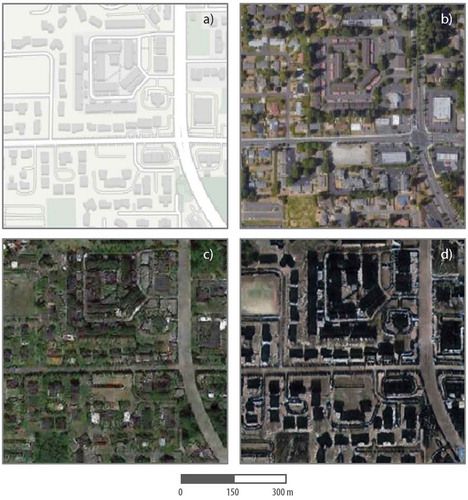

Abbildung a) zeigt die originale Karte einer Nachbarschaft in Tacoma (USA), und b) das zugehörige Satellitenbild. Die unteren beiden Aufnahmen sind Fake-Bilder, zusammengesetzt aus Aufnahmen von Seattle (c) und Peking (d).

Deepfakes sind dafür bekannt, dass sie Berühmtheiten in Videos Falschinformation erzählen lassen oder für betrügerische Inhalte missbrauchen. Die mittels künstlicher Intelligenz (KI) generierten Fotos und Videos stellen dabei Gefahr dar, da immer schwerer erkannt werden kann, dass es sich um Fälschungen handelt. Weitere Risiken, die jedoch unbeachtet zu sein scheinen, gehen von sogenannten Deepfake-Satellitenbildern aus.

Kaum behandelt

Deepfake-Satellitenbilder sind aufgrund des Algorithmus, der auf die Auswertung vieler echter Aufnahmen basiert, weitaus realistischer als Fälschungen, die händisch bearbeitet werden. Laut Bo Zhao, Geografieprofessor an der Universität von Washington, stellt der Einsatz von KI in der Manipulation von Karten und Satellitenbildern eine bisher kaum diskutierte Gefahr dar.

Zusammen mit seinen Kollegen veröffentlichte Zhao kürzlich eine wissenschaftliche Arbeit, in der das Thema "Deepfake-Geografie" untersucht und die Erzeugung sowie Erkennung solcher Fälschungen erforscht wird. Für Zhao müsse man "die Funktion der absoluten Zuverlässigkeit von Satellitenbildern entmystifizieren" und der Allgemeinheit die Gefahren und Risiken, die die künstliche Intelligenz in der Geografie darstellt, bewusst machen.

Diskreditierend

Besonders Geografen bereitet die Ausbreitung solcher gefälschten Aufnahmen und Karten große Sorge, heißt es in einem Bericht von "The Verge". Nicht nur könnten Deepfakes verwendet werden, um Falschinformationen über etwa den Klimawandel, Naturkatastrophen oder kontroverse Standorte zu verbreiten, auch könnten sie dazu beitragen, dass Ergebnisse echter Satellitenbilder diskreditiert werden.

Als Beispiel bietet sich die Recherchearbeit von Journalistinnen und Journalisten, die vergangenes Jahr Satellitenaufnahmen als Beweismittel verwendeten, um Arbeits- und Zwangslager für die Bevölkerungsgruppe der Uiguren in China ausfindig zu machen. Je weiter verbreitet geografische Deepfakes sind, desto einfacher können Belastete, wie etwa die chinesische Regierung, behaupten, dass Beweismittel in Form von Satellitenbildern gefälscht seien.

"Jahrhundertealtes Phänomen"

Zwar ist die Technologie hinter Deepfakes für die Geografie eine neue Entwicklung, das Fälschen und Verändern von Karten jedoch nicht. Wie Zhao und sein Team festhalten, ist die bewusste Manipulation von geografischen Aufzeichnungen ein "jahrhundertealtes Phänomen". Seitdem es Karten gibt, würde der Mensch diese verwenden, um aus verschiedenen Gründen die Wahrheit zu verändern – von mythologischen Karten, die von alten Zivilisationen wie den Babyloniern entworfen wurden, bis zu modernen Propagandakarten, die während des Krieges verteilt wurden, "um die Moral des Feindes zu erschüttern".

So manche Zeichner fügten sogenannte "Paper Towns" und falsche Straßen in ihre Karten ein, um anderen Kartografen Plagiatsfallen zu stellen. Wenn erfundene Orte und Wege in anderen Karten auftauchen, kann man die kopierte Arbeit dadurch beweisen.

Satellitenbilder stets glaubwürdig

Der Einsatz des maschinellen Lernens vereinfacht den Prozess der Fälschung um ein Vielfaches und verbessert das Ergebnis deutlich: "Das Neue an diesen Fälschungen ist, dass die Deepfake-Satellitenbilder so unheimlich realistisch sind. Das ungeschulte Auge würde schnell denken, dass sie authentisch sind. "

Besonders die Authentizität von Satellitenaufnahmen würde in der Regel kaum angezweifelt werden, da Karten und Fotos aus dem Orbit oft von Regierungseinrichtungen oder professionellen Unternehmen erstellt werden und die Generierung dieser mit hohem Aufwand verbunden ist. Aufgrund dieser unangefochtenen Glaubwürdigkeit des Mediums in Kombination mit der gewohnten niedrigen Auflösung von Satellitenbildern sei es ein leichtes Spiel für Deepfakes, die breite Masse zu überzeugen.

Tools für Erkennung

Im Zuge der Studie entwickelte das Team ein Programm, das mittels einer Machine-Learning-Methode, des sogenannten "Generative Adversarial Networks", geografische Deepfakes generiert. Die Forscher arbeiteten im Anschluss ein Programm aus, mit dem Deepfake-Karten anhand der Texturen, Farben und Kontraste erkannt werden können. Doch ähnlich wie bei Tools, die Deepfakes von Personen ausfindig machen sollen, gilt auch hier, dass solche Werkzeuge stetig aktualisiert werden müssen, um zukünftigen Fälschungen gewachsen zu sein.

Die Gefahren, die mit der Verbreitung von Deepfakes geografischer Materialien einhergehen, müssen früh erkannt werden, damit Forscher nicht überrascht werden. Von den Forschern geht eine eindringliche Warnung vor einem Eintritt in die "Dystopie der gefälschten Geografie" aus. (hsu, 29.4.2021)