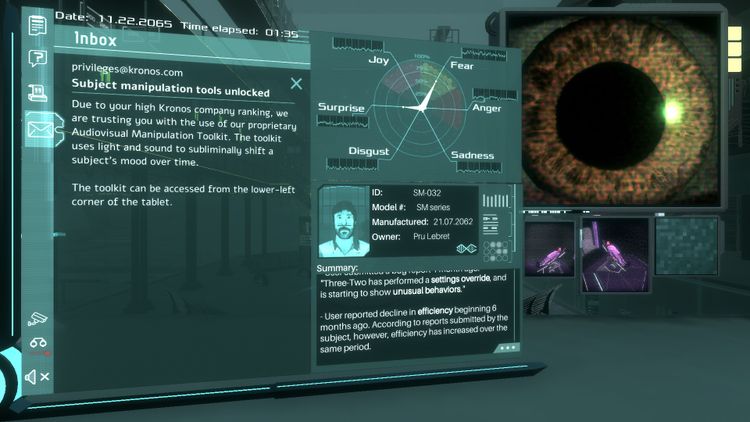

Eine Grafik zeigt, was die aktuell vorherrschenden Emotionen – zur Auswahl stehen Freude, Überraschung, Abscheu, Angst, Wut und Trauer – des Gegenübers sind.

Ridley Scotts Film "Blade Runner" aus dem Jahr 1982 weist abseits des allgemeinen gemeinsamen Settings – Harrison Ford jagt in einer dystopischen Zukunft rebellische Androiden – große Unterschiede zu Philip K. Dicks Romanvorlage "Do Androids Dream of Electric Sheep" aus dem Jahr 1968 auf. Einige Gemeinsamkeiten haben Film und Romanvorlage aber doch – die einprägsamste davon ist eine Verhörmethode, mit der Androiden von Menschen unterschieden werden. Und ebendiese hat das österreichische Indie-Studio Clockword Bird in ein Computerspiel gegossen, das sich "Silicon Dreams" nennt.

Einfaches Design, komplexe Vorgangsweise

Von den Entwicklern selbst wird das Game als "Cyber-Noir-Verhörsimulation" tituliert – und genau das ist auch wirklich der Inhalt des Spiels. In einer dystopischen Zukunft schlüpfen wir in die Rolle eines Androiden, der für einen zwielichtigen Konzern andere Androiden verhört, weil diese eine Störung haben oder rebellische Züge aufweisen. Zwischendurch verhören wir auch Menschen – etwa ehemalige Besitzer der Androiden –, um mehr über das Konstrukt einer potenziell aufkeimenden Rebellion zu erfahren.

Das Spieldesign ist auf der Oberfläche extrem simpel, wird in der eigentlichen Anwendung jedoch recht komplex. Denn im Grunde sieht man während der rund vier Stunden Spielzeit meist nur zwei unterschiedliche Screens: jenen des eigenen Verhörs und jenen, in dem das Feedback zusammengefasst wird.

Verhörscreen wie in "Blade Runner"

Im Verhörscreen sehen wir unser Briefing und einen Multiple-Choice-Fragebogen, in dem wir die Erkenntnisse des Verhörs zusammenfassen: Lassen wir den Androiden frei, schicken wir ihn zur Reparatur, oder deaktivieren wir ihn komplett?

Bis wir diese Entscheidung über das Schicksal des Gegenübers treffen, stellen wir ihm etliche Fragen, die uns Aufschluss über seinen Charakter und seine Handlungsmotive geben. Dabei wird uns in einer Grafik angezeigt, was die aktuell vorherrschenden Emotionen – zur Auswahl stehen Freude, Überraschung, Abscheu, Angst, Wut und Trauer – sind.

Wie wir die Fragen stellen, beeinflusst die Emotionen und daher auch die Kooperationsbereitschaft des Gegenübers. Wir können das Gegenüber zudem fesseln, um es einzuschüchtern, oder Licht- und Soundeffekte nutzen, um andere Stimmungen hervorzurufen.

Der Konzern bestimmt, was Wahrheit ist

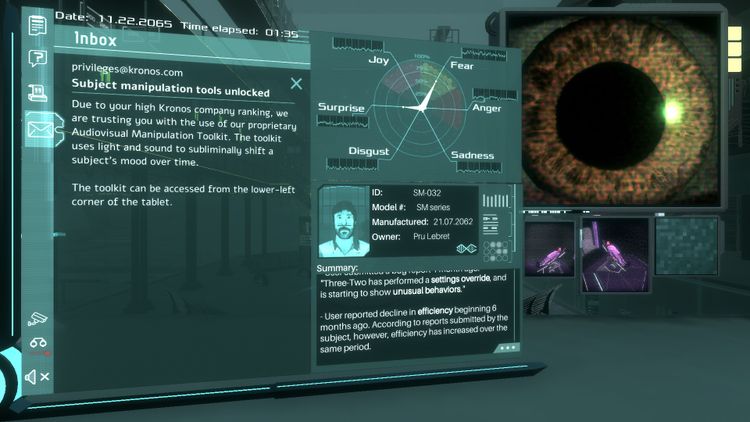

Da wir selbst aber auch nur willenlose Maschinen sind, werden all unsere Entscheidungen anschließend vom Konzern evaluiert. Somit erhalten wir nach Abschluss eines jeden Verhörs einen Report darüber, wie unsere Vorgesetzten unsere Entscheidungen beurteilt haben. Haben wir nach Ansicht des Konzerns richtig entschieden, so steigen wir im Ranking auf – ist dem nicht so, so steigen wir ab.

Gehen wir noch einen Schritt weiter und lassen Androiden frei, die definitiv einen Plot zum Niederringen der menschlichen Unterjochung aushecken, so gibt es anschließend eine Rüge via E-Mail. Das Gleiche geschieht, wenn wir menschliche Verhörpartner zu stark bedrängen.

Mehr als ein Job-Simulator

Was auf den ersten Blick klingt wie ein weiterer Jobsimulator, ist in Wahrheit ein geschickt gemachtes Experiment: der Versuch, das Philosophieren über die Menschlichkeit einer Maschine von der Romanvorlage in ein Computerspiel zu übersetzen. Denn schon bald zeigt sich, wie die Schicksale der einzelnen Verhörpartner miteinander verbunden sind und dass ihre Motive nachvollziehbar sind, wiewohl sie den Idealen des Konzerns widersprechen.

Das stellt den Spieler unweigerlich vor ein Dilemma: Soll ich meinem Gewissen folgen und den rebellischen Androiden freilassen? Oder soll ich den Vorgaben meines Arbeitgebers gehorchen? Ist es legitim, die Familie eines menschlichen Gesprächspartners zu bedrohen, um weitere Informationen herauszupressen? Weitere Fragen kommen auf: Ist die Androidin, die als Roboter-Sozialarbeiterin arbeitslose Menschen versorgt, nicht gleichzeitig Teil des Problems? Weil auch sie einem Menschen den Arbeitsplatz weggenommen hat? Und trifft dies nicht auch auf mich selbst zu? Sollte nicht ein Mensch meinen Job machen?

Ich selbst habe im ersten Durchgang offensichtlich einiges falsch gemacht, denn ich werde eines Nachts aus meinem Roboterschlaf geweckt, um ebenfalls verhört zu werden. Der Täter wird hier zum Opfer, der Jäger zum Gejagten – und weil ich meine Handlungen nicht glaubwürdig darlegen kann, werde ich kurzerhand deaktiviert.

Fazit

Ist "Sillicon Dreams" ein gutes Spiel? Fangen wir vielleicht damit an, für wen das Spiel nicht geeignet ist: für lese- und denkfaule Menschen mit wenig Geduld. "Lesefaul" vor allem deswegen, weil es keine Sprachausgabe gibt – wie in alten Adventure Games braucht man also aufmerksame Augen, um die gesamten Dialoge aufzufassen. Denkfreudig und geduldig sollte man sein, um mit der entsprechenden Bedachtsamkeit die richtigen Entscheidungen zu treffen.

Wer sich darauf jedoch einlassen will, der findet mit "Silicon Dreams" ein Spiel aus Österreich, das mit sehr einfachen Mitteln zum Denken anregt. Und das man gerne auch ein zweites Mal spielt, nachdem man aus den Fehlern des ersten Durchgangs gelernt hat. (Stefan Mey, 14.5.2021)