Das Kommunikationsplattformen-Gesetz ist Anfang April in Kraft getreten.

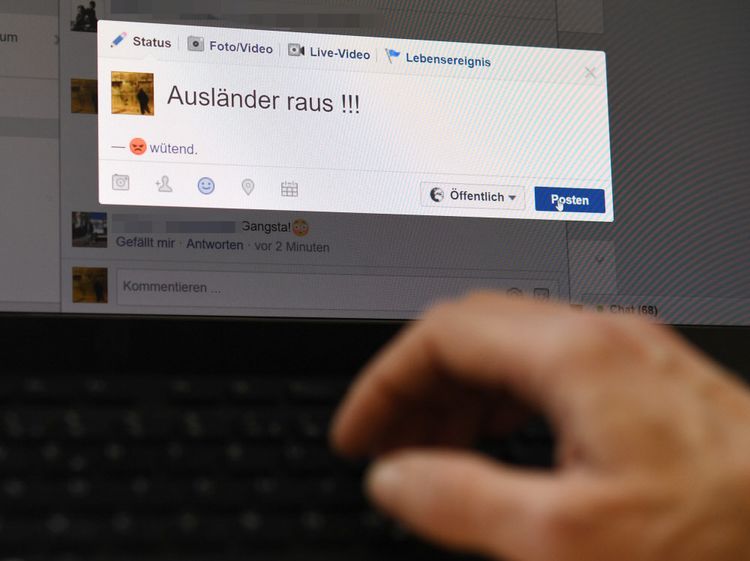

Seit Anfang April sind Internetkonzerne wie Facebook, Google und Co dazu verpflichtet, die einfache Löschung rechtswidriger Inhalte wie Hasskommentare zu ermöglichen. Damals trat das österreichische Gesetzespaket gegen Hass im Netz in Kraft. Sind gemeldete Inhalte offensichtlich illegal, müssen sie innerhalb von 24 Stunden offline genommen oder gesperrt werden. In komplizierteren Fällen beträgt die Frist sieben Tage. Die neuen Regeln scheinen allerdings nicht von allen Unternehmen auf gleiche Art und Weise umgesetzt zu werden.

Facebook und Instagram machen einem die Meldung rechtswidriger Inhalte nach dem Kommunikationsplattformen-Gesetz (KoPl-G) ziemlich einfach. Eine entsprechende Möglichkeit wurde auf den Social-Media-Plattformen prominent platziert, der Prozess ist mit wenigen Klicks abgeschlossen.

Das scheint sich auch im ersten Transparenzbericht von Facebook widerzuspiegeln. Zwischen April und September 2021 gingen insgesamt 17.479 Meldungen über das bereitgestellte Formular ein. Tatsächlich gelöscht beziehungsweise gesperrt wurden 2.713 Beiträge.

Keine einzige Meldung

Bei Youtube ging im selben Zeitraum hingegen keine einzige Meldung ein, die im Sinne des KoPl-G rechtswidrig ist. Dementsprechend wurde auch nichts gelöscht. Zwar stellt die Videoplattform im selben Zug klar, dass sich die Auflistung nur auf Kommentare bezieht. Stutzig macht das auf den ersten Blick trotzdem.

Überprüfung nach Community-Richtlinie

Meldet man einen Kommentar direkt unter einem Video, steht "Hassrede oder explizite Gewalt" eigentlich als Begründung zur Wahl. Schickt man die Meldung ab, wird einem allerdings angezeigt, dass die Prüfung nach den eigenen Community-Richtlinien stattfindet, wie die Journalistin Ingrid Brodnig auf Twitter aufwarf.

Für explizite Beschwerden zu Hassrede gibt es hingegen ein eigenes Dokument – das auf eigene Faust kaum aufzufinden ist. Doch selbst wenn: User müssen nicht nur händisch eintragen, gegen welches Gesetz Inhalte verstoßen, sondern auch noch einen Link zum Gesetzestext heraussuchen. Brodnig hat deshalb einen Schritt-für-Schritt-Leitfaden erstellt. Trotzdem, so schreibt sie, sei das Formular für Nichtjuristen viel zu kompliziert.

Automatisierte Systeme

Die fehlenden Meldungen begründet Google gegenüber dem STANDARD damit, dass 99,5 Prozent aller schädlichen Kommentare von automatisierten Systemen erkannt und entfernt würden. Das angebotene Meldeformular entspreche außerdem den gesetzlichen Anforderungen.

Die Löschung aufgrund von Verstößen gegen die Community-Guidelines kann man allerdings nicht wirklich mit jener gemäß KoPl-G gleichsetzen. Schon alleine wegen der kurzen Fristen und möglicher Konsequenzen bei Nichteinhaltung. Allerdings nur, wenn die Meldung aufgrund eines vermuteten Verstoßes gegen das Gesetz stattfindet.

Ist ein Nutzer mit der Entscheidung einer Plattform nicht zufrieden, kann er dann außerdem Beschwerde bei der Komm Austria einlegen, die bei wiederholten Verstößen Strafen in Höhe von bis zu zehn Millionen Euro verhängen kann.

Für die Erstellung von Community-Richtlinien ist hingegen das Unternehmen selbst verantwortlich. Was gegen diese verstößt, liegt also in eigenem Ermessen der Moderatoren. (mick, 5.11.2021)