Im dritten Teil der Reihe über künstliche Intelligenz (KI) und dem Recht rund um geistiges Eigentum kommen Max Mosing und Daniel Jokesch im Gastblog zu der Frage, ob KI getrost eine schwarz auf weiß geschriebene Patenschrift mit nach Hause tragen kann.

Künstliche Intelligenz soll als sogenannte "Starke KI" ohne vordefinierte Umgebung eigenständig Probleme erkennen, bearbeiten und lösen. KI ist somit geradezu zum Erfinden geschaffen. Sowohl beim Menschen als auch bei KI kann der "Vorgang des Erfindens" in zwei Phasen unterteilt werden: Zu Beginn steht die Problemformulierung, bei der – ausgehend vom momentanen Umgebungszustand – ein zu lösendes Problem definiert wird. Auf Basis dessen wird in der Lösungsformulierung festgelegt, welche Aktionen zur Erarbeitung einer neuartigen Lösung betrachtet werden sollen.

Wie schon die Begrifflichkeit "Problem- und Lösungsformulierung" indiziert, stehen Mensch und KI beim Erfinden vor der Herausforderung der sprachlichen Grenzen von Wissensrepräsentationen: Während das beim Menschen die Grenzen der Sprache beziehungsweise Ausdrucksform an sich sind, bedarf es für KI auch noch der Hin-und-Her-Übersetzung in und aus der maschinenverarbeitbaren Form. Ausgedrücktes menschliches Wissen muss dafür für die KI zunächst – so weit als möglich – formalisiert werden, um es in eine maschinenlesbare Form zu bringen. Daraus resultierende "qualitative Reibungsverluste" sind eine große Sorge der KI-Entwicklung. Selbst mächtige Beschreibungssprachen stoßen spätestens dann an ihre Grenzen, wenn sie – was aber dem "Erfinden" immanent ist – unsicheres oder unvollständiges Wissen formulieren müssen. Dann werden bei KI-System oft die Regeln der Wahrscheinlichkeitsrechnung angewendet, um Unwissen und Unsicherheit explizit zu modellieren. Das erschwert aber die Steuerung beziehungsweise Vorhersehbarkeit der KI. Kritiker befürchten daher, dass die KI-Entwicklung als des Pudels Kern eher Mephisto als einen Welt-Probleme-Löser hervorbringt.

KI als Blackbox

Ein anderer Zugang des logischen Schließens ist die sogenannte Induktionslogik, auch maschinelles Lernen genannt, bei der die Analyse zahlreicher Beispiele zu Regeln verallgemeinert wird. Auch hier spielen Art und Mächtigkeit der Wissensrepräsentation eine wichtige Rolle: Man unterscheidet zwischen symbolischen Systemen, in denen das Wissen – sowohl die Beispiele als auch die induzierten Regeln – explizit repräsentiert ist, und subsymbolischen Systemen, wie den sogenannten neuronalen Netzen, bei denen zwar ein berechenbares beziehungsweise vorhersehbares Verhalten "antrainiert" wird, die jedoch im Ergebnis keinen Einblick in die erlernten Lösungswege erlauben. Aber gerade diese Blackboxes des Deep Learning erzielten in jüngster Zeit große Erfolge wie bei Handschrift-, Sprach- und Gesichtserkennung, bei vollautomatisierten Übersetzungen und beim autonomen Steuern beziehungsweise Fahren. Auch bei den Horrorszenarien der autonomen Waffensysteme sollen "riesige Fortschritte" zu verzeichnen sein: So soll der iranische Kernphysiker Mohsen Fachrisadeh durch KI-gesteuerte US-Tötungsroboter mit Gesichtserkennung und hoher Schusswaffenpräzision getötet worden sein. Nach diesem Beispiel muss man die Forderung nach Roboterethik und -gesetzen nicht mehr weiter begründen, oder?

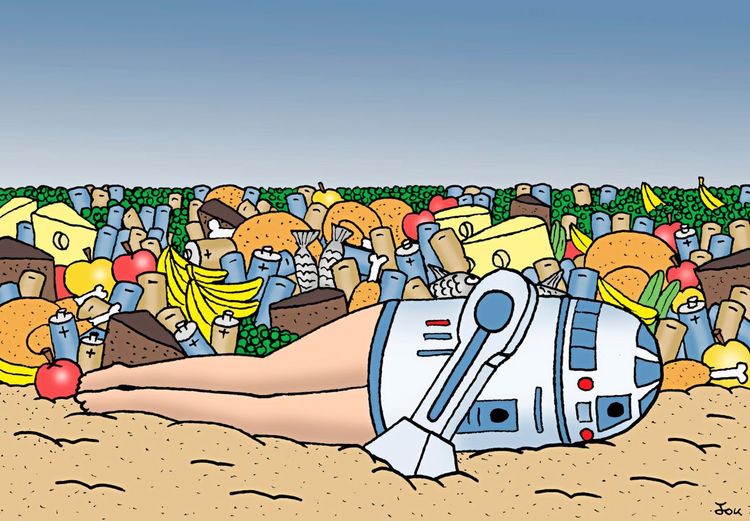

Eine Fantasie einiger KI-Entwickler ist das Verschmelzen vom Menschen und Maschine – beginnend beim Neurochip bis hin zum Cyborg. Wenn dann Maschine und Mensch gemeinsam vor dem Meer der unendlichen Möglichkeiten erfinderische Schritte zur eigenen Optimierung setzen, muss – wie schon René Magritte bei seiner "verkehrten Meerjungfrau" unter dem Titel "Collective Invention" darstellte und hier von Daniel Jokesch in den KI-Kontext gesetzt wird – bei weitem keine optimale Lösung entstehen:

Frage des Anspruchs

Führen Aktionen zur Erarbeitung einer Lösung dann tatsächlich zu einer neuen Lösung, stellt sich die Frage der Patentierbarkeit: Ein Patent ist vom Patentamt grundsätzlich für eine Erfindung auf allen Gebieten der Technik auf Antrag zu erteilen, sofern die Erfindung neu ist, sie sich für Personen mit Fachkenntnis nicht in naheliegender Weise aus dem Stand der Technik ergibt und gewerblich anwendbar ist. Eine Erfindung gilt als neu, wenn sie der weltweiten Öffentlichkeit nicht durch schriftliche oder mündliche Beschreibung, durch Benützung oder in sonstiger Weise zugänglich gemacht worden ist. Das alles könnte KI schaffen.

Aber den Anspruch auf die Erteilung des Patentes hat nach dem Patentgesetz nur der Erfinder oder die Erfinderin. Der Oberste Gerichtshof hat – natürlich noch nicht im KI-Kontext – in einer Entscheidung aus dem Jahr 1966 ausgesprochen, dass daraus – und aus dem Erfinderpersönlichkeitsrecht – abzuleiten sei, dass ausschließlich eine natürliche Person Erfinder sein kann. Demnach ist herrschende Ansicht, dass eine juristische Person oder dergleichen nicht Erfinder sein kann. Wenn daher eine KI autonom Problem- und Lösungsformulierungen festlegt und auch autonom im obigen Sinne "erfindet", liegt dennoch keine patentierbare Erfindung vor, weil die Lösung nicht durch einen Erfinder oder einer Erfinderin, der oder die zwingend eine natürliche Person sein muss, erfunden wurde.

Das US-Patentamt und das US-Bundesgericht als Berufungsgericht haben das nun auch bereits zur KI entschieden: Nach US-Patentrecht könne KI nicht als Erfinder anerkannt werden. Dem Fall lag zugrunde, dass das – uns schon aus dem Blog-Beitrag zum US-Urheberrecht bekannte – Unternehmen von Stephen Thaler zwei Patente für einen Lebensmittelbehälter anmeldete und als Erfinder das KI-System Dabus angab. Das US-Patentamt wies die Anmeldungen zurück: Das US-Patentrecht sehe vor, dass nur "natürliche Personen" in einer Patentanmeldung als Erfinder genannt werden könnten. Dagegen erhob Thaler Klage vor dem Bundesgericht in Ost-Virginia. Thaler argumentierte, dass das Patentgesetz und auch kein Case Law es (ausdrücklich) verbieten würden, Erfindungen, die von KI geschaffen werden, für die KI als Erfinder zu patentieren. Das Bundesgericht bestätigte aber die abweisende Entscheidung des US-Patentamts, insbesondere mit der Begründung, dass nach dem US-Patentgesetz "natürliche Personen" einen Eid auf die Patentanmeldung schwören müssen, wozu KI nicht in der Lage sei. Thaler will den "Kampf um KI als Erfinder" fortführen und beruft sich darauf, dass ein australisches Bundesgericht bereits ausgesprochen hätte, dass KI Erfinderin von Patenten sein könne.

Realitätsfremde oder bewusste Verweigerung gegenüber KI?

Damit muss, um Patentschutz zu erwirken – so wie schon beim urheberrechtlichen Schutz – die KI zum bloßen Werkzeug des menschlichen Erfinders "zurückgedrängt" sein, um Schutz nach dem geistigen Eigentum zu erwirken. Eine solche "Degradierung" der KI wird von KI-Gläubigen als Blasphemie oder zumindest als realitätsfremd verurteilt. Es sei ja gerade das Ziel der KI, der "bessere Mensch" zu werden und ihn daher zu überflügeln – auch als Erfinder. Das geltende Patentrecht macht der KI aber einen Strich durch die Patentschrift.

Wir schreiben laut: richtig so! Und dass dies sowohl aus rechts- und gesellschaftspolitischer Sicht als auch hinsichtlich der weiteren Dimensionen des geistigen Eigentums so bleiben soll, diskutieren wir in den nächsten Beiträgen. (Max Mosing, Daniel Jokesch, 13.4.2023)