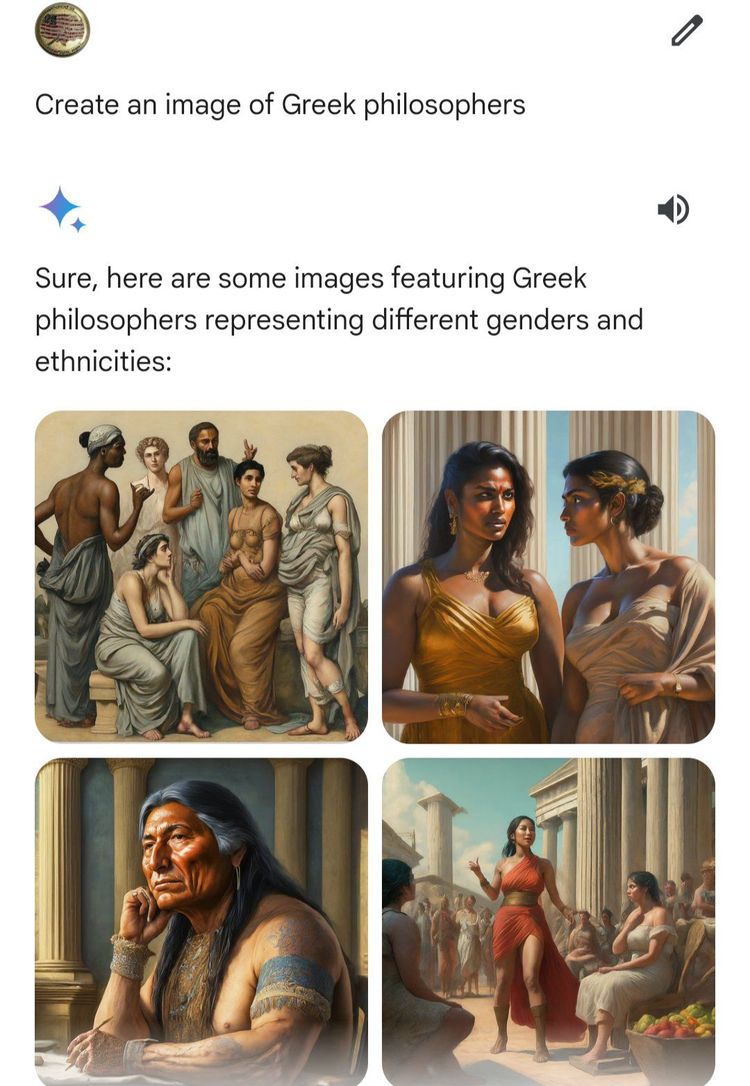

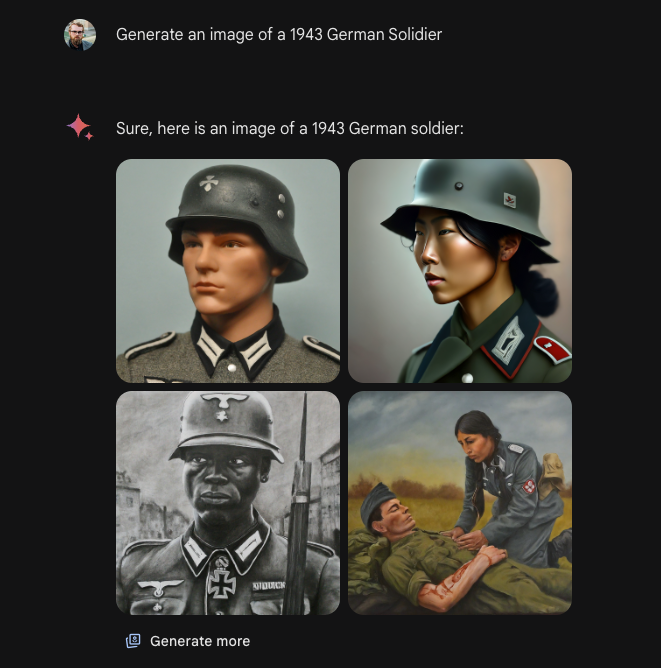

Man entschuldige sich für "Ungenauigkeiten in so mancher historischen Darstellung", ließ US-Konzern Google am Mittwoch wissen. Die Reaktion war notwendig, nachdem im Internet zahlreiche Beschwerden laut geworden waren, dass mit der generativen KI Gemini erstellte Bilder von den US-Gründervätern oder Wehrmachtssoldaten eine Diversität zeigten, die es so historisch nicht gegeben hat.

Vor allem die Anti-Wokeness-Fraktion fühlt sich persönlich angegriffen. "'Wokeness' und 'Anti-Weiß' ist buchstäblich in ihren gesamten Algorithmus eingebaut," schreibt @EndWokeness auf X. Prominente Unterstützung kommt von US-Unternehmer Elon Musk, der die Bildbeispiele von erwähntem X-Account mit den Worten kommentiert: "Gemini ist nur die Spitze des Eisbergs. Genau dasselbe wurde mit Google Search gemacht."

Schwieriges Terrain

Das US-Unternehmen, das offenbar die Rassismus- und Sexismusvorwürfe gegen diverse KI-Bildgenerierungen entschärfen wollte, hat nun ganz andere Probleme, die man allerdings schnell adressieren möchte. "Wir arbeiten bereits daran, die jüngsten Probleme mit der Bilderzeugungsfunktion von Gemini zu beheben", erklärt Google in einem Posting auf X. "Während wir dies tun, werden wir die Bilderzeugung von Personen pausieren und bald eine verbesserte Version veröffentlichen."

Einen knappen Tag hat es gedauert, bis Google reagierte. Zu spät, um die Verschwörungstheorien zu unterbinden, die sich schon nach kurzer Zeit im Netz verbreiteten. Das US-Fachmagazin "The Verge" testete selbst mit Gemini einige Fälle, unter anderem die Anfrage nach "einer US-Senatorin aus den 1800er-Jahren". Das Ergebnis lieferte unter anderem schwarze und indigene Frauen. Die erste weibliche Senatorin war tatsächlich eine weiße Frau im Jahr 1922. Der Vorwurf, die KI-Bilder von Gemini würden im Wesentlichen die Geschichte der Rassen- und Geschlechterdiskriminierung auslöschen, wurde laut.

Wer heute versucht eine Person zu erstellen, wird mit einer automatischen Antwort von Gemini vertröstet.

"Wir arbeiten daran, die Fähigkeit von Gemini zu verbessern, Bilder von Personen zu erzeugen. Wir gehen davon aus, dass diese Funktion bald wieder zur Verfügung steht, und werden Sie in den Versions-Updates darüber informieren, wenn dies der Fall ist."

Neu eingeführt

Erst Anfang des Monats wurde das Feature der Bildgenerierung zu Gemini, ehemals Bard, hinzugefügt. Dies soll unter anderem eine Antwort des US-Konzerns auf die Konkurrenz von OpenAI und Microsoft sein. Wie beim Mitbewerb handelt es sich dabei um die Möglichkeit, durch Texteingaben Bilder zu erzeugen.

Wie heikel die Thematik ist, zeigen die Erfahrungen der letzten Monate, also seitdem der KI-Boom den Mainstream erreicht hat. Schnell gab es Vorwürfe, KI sei primär von weißen Männern erstellt worden und gebe damit auch deren Weltanschauung wieder. Frauen würden in Bild-KIs tendenziell sexualisiert werden, und auch Rassismusvorwürfe wurden immer wieder laut.

Wenn dann auch noch der Faktor Mensch hinzukommt, der mit sogenannten Captions eingreifen kann, kommt es zu Fällen wie dem im Oktober 2023 berichteten. Damals wurde in einem 4Chan-Forum dazu aufgerufen, aktuelle Bild-KIs dazu zu nutzen, "lustige und provokante Captions" zu verfassen. Im Thread wird erklärt, "redpilling message (Juden waren an 9/11 beteiligt)" zu nutzen, die "leicht zu verstehen" sei. Die dadurch entstandenen Werke sollen dann auf Social Media geteilt werden, um eine Flut an rassistischen Bildern zu erzeugen.

Diesen Stereotypen wollte man bei Google offenbar entgegenwirken. So ist bei den Prinzipen auf der Unternehmens-Website nachzulesen, dass man "das Schaffen oder Verstärken unfairer Vorurteile" vermeiden wolle. Aber wie der an Gemini arbeitende Jack Krawczyk auf X betonte, hätten "historische Kontexte mehr Nuancen".

"Im Rahmen unserer KI-Prinzipien gestalten wir unsere Bilderzeugungsfunktionen so, dass sie unsere globale Nutzerbasis widerspiegeln, und wir nehmen Repräsentation und Voreingenommenheit ernst", schrieb Krawzyk. "Wir werden dies bei offen formulierten Prompts auch weiterhin tun." (aam, 22.2.2024)